概览

NVIDIA NeMo 是什么?

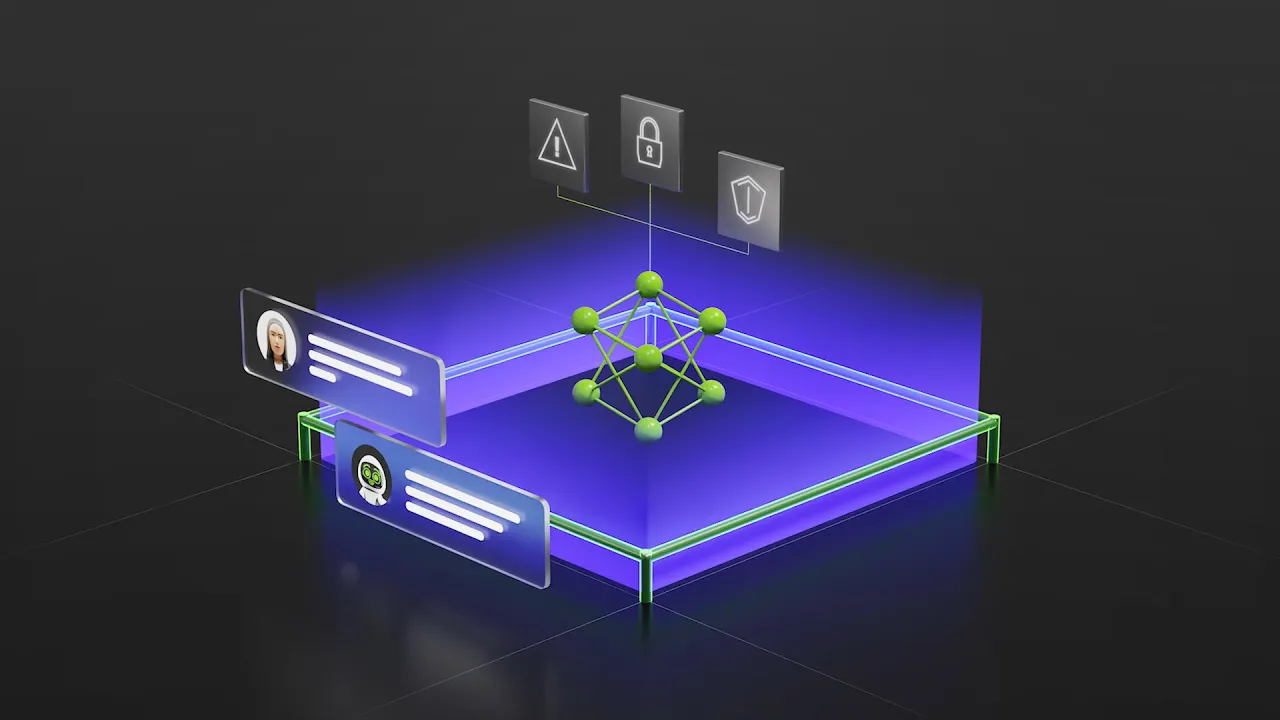

NVIDIA NeMo™ 是一个用于管理 AI 智能体生命周期的综合工具套件。它包含用于数据处理、数据生成、模型微调和评估、强化学习、语音、安全性及智能体可观测性的开放库和微服务。使用 NeMo 自定义 NVIDIA Nemotron™ 和其他模型,构建面向您的专业领域需求和数据的生产级专用智能体系统。

可与现有 AI 平台集成,并支持云、本地和混合部署。

特性

用于管理 AI 智能体生命周期的工具

AI 智能体生命周期是一个端到端流程,用于在生产应用中开发和改进 AI 智能体。NVIDIA NeMo 提供支持此工作流每个步骤的工具,因此企业可以构建功能强大、安全且持续学习的专用智能体。

| 构建 | |

|---|---|

| 准备 AI 就绪型数据 将现有的多模态数据集处理为高质量、AI 就绪型格式,以用于开发流程,并生成合成数据以填补关键数据缺口。 |

|

| 选择合适的模型 选择或构建适合业务场景的模型:从开放的 Nemotron 模型、其他开放或专有模型中进行选择,也可以从零开始训练。通过评估流程完成验证,并根据需要进行微调。 |

|

| 构建您的 AI 智能体 跨框架对智能体工作流进行性能分析和优化,内置的性能分析、瓶颈检测、基于评估的 RL 调优能力,并与 LangChain、LlamaIndex 等智能体生态系统的兼容。 |

|

| 部署 | |

| 部署具有出色性能的智能体 通过高吞吐量、低延迟推理优化生产智能体,确保其可以扩展以满足企业需求,并提供快速可靠的响应。 |

|

| 以数据为基础并应用防护措施 使用检索增强生成 (RAG) 将智能体响应固定在可信知识中,同时应用安全性、合规性和内容审核护栏。 |

|

| 优化 | |

| 监测并收集反馈 跟踪智能体在现实世界中与用户和其他系统的交互。系统评估其性能和准确性,寻找持续改进的机会。 |

|

| 借助数据飞轮不断改进 使用从监测中收集的反馈和数据创建数据驱动的飞轮,以迭代方式重新训练智能体,使其随着时间的推移不断优化并保持有效性。 |

|

用例

NeMo 如何使用

了解 NVIDIA NeMo 如何为行业用例提供支持,以及如何快速开始 AI 开发。

-

AI 智能体

-

用于代理式 AI 的 SDG

-

AI 助手

-

企业搜索

-

内容生成

-

人形机器人

AI 智能体

AI 智能体正在改变各行各业的客户服务,帮助公司加强客户对话,实现高分辨率,并提高人类代表的生产力。AI 智能体可以处理预测任务、推理和解决问题,接受培训以理解行业特定术语,并从组织的知识库中提取相关信息,而不管这些数据位于何处。

用于代理式 AI 的合成数据生成

专门的代理式系统需要大量高质量的数据集,这些数据集从真实世界的来源收集起来既缓慢又昂贵。通过仿真或生成式 AI 模型创建的合成数据可以在没有隐私限制或质量问题的情况下创建无限的训练场景,从而消除这一瓶颈。这有助于更快地开发推理 LLM、多步骤决策者和多模态 AI 助手。

企业搜索

企业每年会产生数以万计的文档,包括 PDF、报告、演示文稿等,这些文档包含文本、图像、图表和表格,分散在相互独立的系统中。基于 AI 驱动的企业搜索将这些分散的数据转化为统一知识库,使员工能够通过对话即可实时获取洞察,以更低的成本实现更高效的决策。

内容生成

生成式 AI 可基于企业的领域专业知识和专有 IP 生成高度相关、准确的定制化内容。

人形机器人

人形机器人可以快速适应以人类为中心的当前城市和工业工作空间,处理繁琐、重复或体力要求高的任务。它们的多功能性使它们可以应用于从工厂车间到医疗健康设施等多种环境,这些机器人可以协助人类,并通过自动化缓解劳动力短缺问题。

Apptronik

优势

深入了解 NVIDIA NeMo 为代理式 AI 带来的优势

全面的模块化 AI 智能体套件

使用可互操作的企业级软件套件,实现对智能体全生命周期的管理,涵盖数据管理、后训练、评估、防护、可观测性和持续优化。

大规模加速

使用企业数据部署和扩展数据飞轮,并利用 GPU 加速训练、推理、多节点扩展和经济高效的优化来处理高吞吐量代理工作负载。

提高投资回报率

更快地构建、定制和部署专用代理系统,缩短投入生产的时间,并最大限度地提高 AI 投资回报。

安全且可用于生产环境

保护敏感数据、执行策略和提示词安全护栏、验证模型并持续检测漏洞。借助 NVIDIA AI Enterprise,在云、数据中心和边缘环境中实现安全部署,提供企业级支持和稳定性保障。

客户案例

行业领导者如何通过 NeMo 推动创新

采用者

各行业的领先采用者

-

客户

-

合作伙伴

资源

最新 NVIDIA NeMo 资源

-

博客

-

会议

-

培训

-

视频

下一步

准备好开始了吗?

使用合适的工具和技术,将生成式 AI 模型从开发阶段向生产阶段推进。

面向开发者

了解开始使用 NVIDIA NeMo 进行开发所需的所有资源,包括最新文档、教程、技术博客等。

联系我们

与 NVIDIA 产品专家交流,了解如何借助 NVIDIA AI Enterprise 的安全性、API 稳定性和支持从试运行阶段向生产阶段推进。