概览

什么是对话式 AI?

对话式 AI 为 AI 虚拟助手、数字人、聊天机器人等提供支持,为个性化、自然的人机对话铺平了道路。但对话式 AI 必须准确和快速才能发挥作用。借助 Nemotron Speech 开放模型和 NVIDIA Riva 库,开发者可以构建响应式语音和翻译功能,并为代理式 AI 应用添加自然语音界面。

优势

探索使用对话式 AI 的好处

智能体效率

通过客户对话实时转录,分析客户对话并提供建议,进而快速解决客户疑问,为客服中心坐席提供支持。

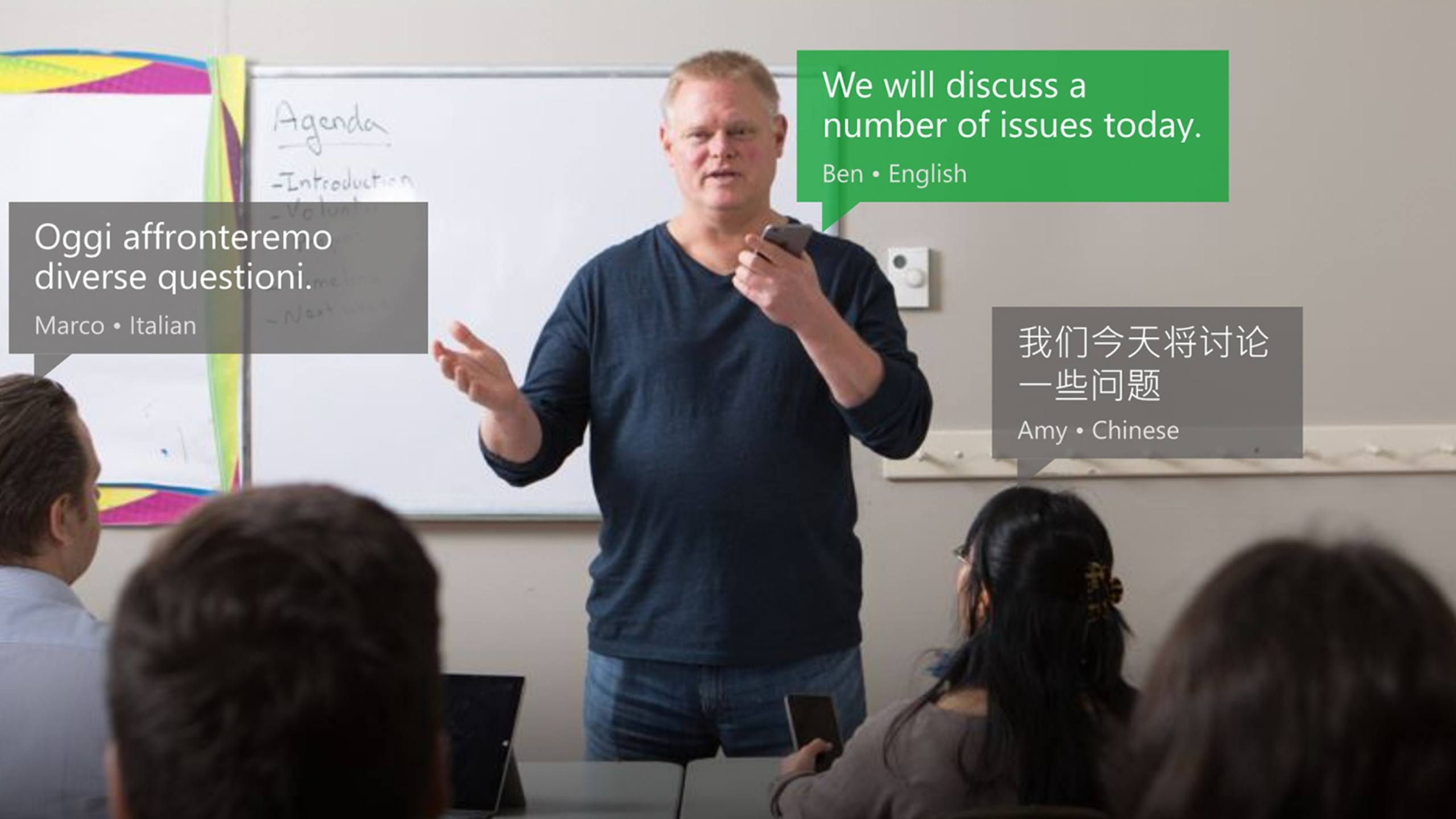

数字和全球无障碍访问

帮助听力障碍者消费音频内容,帮助语言障碍者以多种语言表达自己。

24/7 全天候可用

使用聊天机器人和 AI 虚拟助手解决客户问题,并在人工客服正常工作时间之外为客户提供有价值的信息。

令人愉悦的体验

通过实时字幕、生成富有表现力的合成声音和理解客户偏好等功能,提供令人愉悦的体验。

软件

探索我们的对话式 AI 软件

应用场景

如何应用对话式 AI

了解 NVIDIA AI 如何支持行业用例,以及如何通过精选的示例快速启动对话式 AI 开发。

-

医疗健康智能体

-

AI 虚拟助手

-

代理协助

-

AI 翻译服务

-

物理 AI

医疗健康智能体

医疗健康领域正在通过高保真、情境感知的 AI 重塑医患交互模式。借助利用 Nemotron 模型,机构能够在临床效率与患者体验之间的实现平衡。

环境感知式语音智能体能够自主生成结构化临床文档,精准理解语境和意图。这类语音智能体能够处理预约、问诊登记等高频患者交互场景,并通过动态推理能力,提供富有同理心、个性化的服务。

AI 翻译服务

他们可以使用 Nemotron 模型进行总结和分析,从而确保有效的沟通和顺畅的全球互动。

物理 AI

服务机器人和语音控制设备在全球各地的医院、工厂、机场和零售店中日益普及。它们通过处理餐馆和工厂中的日常重复性任务来协助一线工作人员完成工作,帮助客户寻找店内商品,并支持医生和护士为患者提供医疗服务。通过在边缘设备端直接部署 Nemotron Speech 模型,这些机器人能够提供近乎即时的语音交互,并在网络连接受限的环境下仍能保持运行可靠性。

客户案例

行业领导者如何通过对话式 AI 推动创新

资源

对话式 AI 资源的最新动态

-

博客

-

会议

-

培训