这一场景拍摄于 2018 年 10 月的通勤高峰期,拍摄地点是曼哈顿市中心布莱恩特公园附近的一栋写字楼的 16 层窗口。在 2020 年 3 月新冠疫情期间,这位艺术家创作了这一 Dreamscape 作品,当时,这样繁华热闹的场景开始让人觉得是一个遥不可及的梦。它将计算摄影与 AI 相融合,创造出一个引人入胜、令人着迷的环境。

Daniel Ambrosi

对于 Daniel Ambrosi 来说,计算摄影不仅仅是营造出一种空间感,而是在于从内在、认知和情感上传达我们对环境的感受。

艺术作品

抽象之梦

2020/2021

计算摄影 + 人工智能

作为我们 Dreamscape 项目的下一步演进,该系列进一步将生成的艺术作品与基本的摄影作品分离开来,探索潜意识。这些循环播放的抽象之梦视频旨在唤起一种冥想效应,产生深度感知的幻觉,通过颜色和纹理的变化逐渐淡化或增加类似的特征。

Bryant Park Dreamscape(布莱恩特公园梦境)(疫情爆发前)

2020

计算摄影 + 人工智能

创作过程

创作过程中,艺术家开发出由 AI 增强的“全场景”艺术作品,首先在一个地点拍摄了 45 张照片,然后对其进行拼合 (Autopano Pro) 和混合 (Aurora HDR Pro) 处理,形成一个巨大的(超过 4.82 亿像素)全景图,并在 Photoshop 中进行裁剪和美化。这幅作品使用在 NVIDIA Quadro RTX GPU 上运行的 Google DeepDream 专用版本处理。

最后,Daniel 尝试使用多种工具和技术(包括 Forge 滤镜中的效果),进一步探索他的“梦境”中固有的图形表现手法可能性。他最近的尝试产生了一个系列作品,他称之为“无限梦想”,探索了受立体主义启发的“折射”梦境。

这个加长版视频循环展示了艺术家创作过程中的各个阶段 - 拍摄/组合 63 张超过 2.95 亿像素的原始全景照片;使用 DeepDream 第一次应用 AI 增强效果;使用 Forge 滤镜进行抽象化处理;第二次应用 DeepDream;以及混合从原始全景图的三个不同区域提取的细节。

技术:计算摄影 + 人工智能

相机:索尼 RX1 或索尼 RX1Rii

图形软件/硬件:Aurora HDR Pro、Autopano Pro、Adobe Photoshop、Filter Forge Pro/iMac

AI 软件/硬件:由 Joseph Smarr (Google) 和 Chris Lamb (NVIDIA) 为艺术家定制的 Google DeepDream 开放源代码专有版本/在 Amazon EC2(弹性计算云)上运行的四卡 GPU 计算服务器。

在这段名为“Dreamscape:艺术背后的科技”的视频中,工程师 Joseph Smarr (Google) 和 Chris Lamb (NVIDIA) 以非专业人员的手法阐释了如何修改 Google 的开源 DeepDream 软件,以在拥有数亿像素的图像上运行。了解这一创新的流程如何使计算摄影艺术家 Daniel Ambrosi 将作品提升到新高度。

关于 Daniel Ambrosi

Daniel Ambrosi 是新兴 AI 艺术运动的创始人之一,素以在人与 AI 的混合艺术中的微妙平衡而闻名。自取得康奈尔大学建筑学士学位和 3D 图形硕士学位以来,近 40 年来,他一直在探索新的视觉呈现方法。2011 年,Daniel 设计了一种独特的计算摄影形式,可生成异常富有沉浸感的风景图像。

主题会谈

Allison Parrish

《22 Compasses》是一本用机器学习拼写和语音模型撰写的诗集。该模型在所谓的离散类别之间的负空间中发明了一些新词。

创作过程

使用的数据集:在英语中,单词拼写方式与发音方式之间不存在直接的关系。CMU 发音词典是免费提供的在线数据库,收录了英语单词及其音标。此数据集已用于训练一个机器学习模型,能通过单词的拼写发出单词的读音,还能拼写出任意声音(即使它们不是词典中的“真正单词”)。

使用的技术:Keras 是主要的机器学习框架,利用它可以轻松创建一个名为 Pincelate 的定制序列到序列模型,以便将字母“翻译”为音素特征。诗歌本身通过 Python 代码生成,这些代码利用此模型将两个或更多个单词混合在一起并拼出其读音。

如何使用 AI:处理用于从拼写预测音素的机器学习模型的隐藏状态,从而可以生成具有特定特征的新的无意义单词。

关于 Allison Parrish

Allison 是计算机程序员、诗人、教育工作者和游戏设计师,其教学工作和实践解决了在语言和计算机相遇时出现的异常现象。她是纽约大学互动电信项目的助理艺术教授,她在 2008 年取得了该校的硕士学位。

Allison 在 2016 年被“乡村之声”评为“诗歌机器人最佳制作者”,她使用计算机生成的诗歌最近发表在《BOMB》杂志和《Nioques》上。她还是《@Everyword: The Book》(Instar, 2015) 的作者,该书收集了她广受欢迎的长期自动化写作项目的成果(该项目在 Twitter 上发布了英语中的每个单词)。Allison 与 Adam Simon 和 Tim Szetela 合作设计了一款名为“Rewordable”的单词游戏,该游戏在成功完成一轮 Kickstarter 融资后于 2017 年 8 月由 Penguin Random House 发布。2018 年,她的第一本由计算机生成的全长诗集《Articulations》由 Counterpath 出版。

Allison 出生在犹他州的西邦蒂富尔,目前住在布鲁克林。

Nao Tokui 和 Qosmo

制造混乱:Nao Tokui 和 Qosmo 充分利用 AI 某些不可预知的行为进行打破陈规的思考和创作。

过程

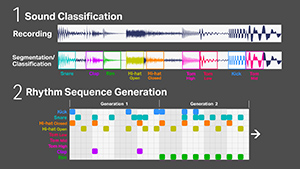

神经网络 Beatbox 是一项音乐实验,在以下几项的交叉处开展:艺术家对日常声音的浓厚兴趣、节奏和引入 AI 所带来的迷人惊喜。

Nao 一直着迷于我们周围的声音及其激发想象力的能力。他自己录制了各种环境音效,并与 Qosmo 一起创建了一个基于人工智能的网站,该网站展示了谷歌街景图像与匹配的“想象”环境音效。

作为一名 DJ,节奏始终是 Nao 音乐练习的核心。这位艺术家使用成百上千种公开的舞蹈音乐节奏 MIDI 数据,对基于变分自动编码器 (VAE) 的节奏生成器模型进行训练。下面直观呈现了该模型潜在空间中的潜在节奏模式,以及所选模式的音频样本。

神经网络 Beatbox 由两个部分组成:(1) 基于 CNN 的声音分类模型,它对录制的声音进行分段和创建的即时架子鼓;(2) 上一节中描述的节奏生成模型。

通过整合这两个组件和这位艺术家的两份独立激情,神经网络 Beatbox 不断根据我们周围的日常声音生成令人兴奋的节拍。艺术家们发现 AI 模型的细微缺陷很有吸引力。他们还预见到 AI 在未来不只是复制我们人类创作的音乐,而是还会创造一些新颖的东西,进而激发人类的创造力。

为了创作出一首独特的乐曲,Nao 还使用他多年来收集的现场录音数据集训练了一个 SampleRNN 模型。经过数天的训练,该模型开始生成无穷无尽的虚构环境音效。

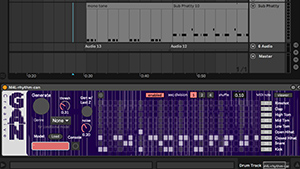

之后,他扩展了节奏生成模型,将 GAN(生成式对抗网络)框架包括在内。他添加了一个额外的判别器,为生成的节奏模式划分舞蹈音乐流派。这个 Creative-GAN 方案还激励生成器“混淆”分类器;这位艺术家进而预测会出现挑战该模型产生的流派分类的独特节奏模式。

最后,Nao 将所有成果(SampleRNN/Creative-GAN 节奏生成和 MelodyVAE 模型)都融入到他的作品“合成环境音效”中。他自己并未手动添加或删除一个 MIDI 音符。他的模型生成了所有序列,他很喜欢这些序列的特性,并将合适的序列拼接在一起。所产生的作品反映了这个时代的不确定性和“日常”生活的回忆。在这个作品中,Nao 展示了拥抱 AI 的有机性可带来独特结果和扩展创造力。

关于 Nao Tokui

Nao Tokui 是位于日本的艺术家兼研究人员。在东京大学攻读博士学位期间,他发行了第一张音乐专辑和其他单曲,其中包括与日本嘻哈界的传奇制作人 Nujabes 合作的 12 英寸唱片。从那时起,他一直在探索利用 AI 扩展人类创造力的可能性。他最近的工作包括开展 AI DJ 项目,在该项目中,基于机器学习技术的 DJ 与人类 DJ(Nao,他自己)通力合作,轮流选择和播放歌曲(一次一首)。另外他还与 Brian Eno 进行合作。他的作品曾在纽约 MoMA、Barbican Centre(伦敦)、InterCommunication Center(东京)等地展出。2021 年 1 月,他出版了第一本关于 AI 和创造力的书籍。

Medium | SoundCloud | 网站

Madonna(圣母玛利亚)

Oxia Palus

2020/GAN、GPU、多光谱成像

Oxia Palus 正在运用 AI 的强大力量,发现被时间遗忘的艺术杰作。这是一种强有力的历史和创新科技二分法,可以让我们真正洞悉被时代遗忘的艺术。

创作过程

第一步

Leonardeschi 是一群在达芬奇工作室工作或受其影响的艺术家,他们的 225 幅画被用来训练 NVIDIA 的 pix2pixHD 模型。

第三步

左边的视频显示了一组不同的输入颜色图,展示了《岩间圣母》X 光扫描照片的一个片段。右侧视频显示了 pix2pixHD Leonardeschi 模型的输出,在左侧有一组输入颜色图。X 光扫描照片并不是理想的伪影轮廓。但是,通过稍加调整,就可以创造出流畅的潜在重建效果视频。

绘画

带有标签的配准图像被分段(放大圣母像),随后生成一系列增强段,对亮度、对比度和锐度上进行调整。然后,这些增强段传递给经过训练的 Leonardeschi 模型,并运行推理,在一组画作中转换增强分段。在探索一组绘画(可能的解决方案)后,创作者手动选择了最美观的结果。最终的圣母 画作犹如达芬奇再世之作。

关于 George Cann

George 通过循环的路径进入 AI 艺术世界 – 从艺术到空间科学,从机器学习到艺术。他的作品用 AI 重建过去,为 AI 如何创造新的艺术价值提供了另一种途径。George 也是伦敦大学学院的博士生,研究火星大气中的生物信号,他拥有伦敦大学学院空间科学与工程硕士学位和沃里克大学数学和物理学学士学位。